Adaptador InfiniBand e Ethernet NVIDIA ConnectX-7 MFP7E10-N005 400Gb/s Dual-Port QSFP NDR, PCIe Gen5

Detalhes do produto:

| Marca: | Mellanox |

| Número do modelo: | MFP7E10-N005 (980-9I73V-000005) |

| Documento: | MFP7E10-Nxxx.pdf |

Condições de Pagamento e Envio:

| Quantidade de ordem mínima: | 1 unidade |

|---|---|

| Preço: | Negotiate |

| Detalhes da embalagem: | Caixa externa |

| Tempo de entrega: | Baseado no inventário |

| Termos de pagamento: | T/T |

| Habilidade da fonte: | Fornecimento por projeto/lote |

|

Informação detalhada |

|||

| Número da peça: | MFP7E10-N005 (980-9I73V-000005) | Tipo de cabo: | Cabos de fibra multimodo |

|---|---|---|---|

| Tipo de fibra: | OM4, 50/125 µm | Comprimento: | 5 metros |

| Conectores: | MPO-12/APC (feminino) | Taxa de dados: | Até 400 Gbps |

| Destacar: | Adaptador NVIDIA ConnectX-7 de 400Gb/s,Adaptador InfiniBand QSFP de porta dupla,Adaptador Ethernet PCIe Gen5 |

||

Descrição de produto

NVIDIA ConnectX‐7 MFP7E10-N005

400Gb/s NDR InfiniBand & 400GbE Adaptador · PCIe Gen5 x16 · Dual-Port QSFP · Segurança em linha · GPUDirect® · NVMe-oF · Tempo PTP avançado

400 Gb/s

2 x QSFP · PCIe HHHL

PCIe Gen5 x16

IPsec / TLS / MACsec

Hong Kong Starsurge Group Co., Limited

A Hong Kong Starsurge Group Co., Limited é uma fornecedora de hardware de rede, serviços de TI e soluções de integração de sistemas orientada por tecnologia.A empresa atende clientes em todo o mundo com produtos incluindo switches de rede, NICs, pontos de acesso sem fio, controladores, cabos e equipamentos de rede relacionados.FabricaçãoA empresa também oferece soluções de IoT, sistemas de gerenciamento de rede, desenvolvimento de software personalizado, suporte multilíngue e entrega global.Com uma abordagem orientada para o clienteA Starsurge se concentra em qualidade confiável, serviço responsivo e soluções personalizadas que ajudam os clientes a construir infraestrutura de rede eficiente, escalável e confiável.

Visão geral do produto

O NVIDIA ConnectX‐7 MFP7E10-N005 é um adaptador de alto desempenho de duas portas de 400Gb/s que suporta tanto a InfiniBand (NDR, HDR, EDR) quanto a Ethernet (400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE).Aproveita a interface host PCIe Gen5 x16 e inclui acelerações de hardware para segurança (IPsec/TLS/MACsec em linha), armazenamento (NVMe‐oF, GPUDirect Storage) e rede (ASAP2 SDN, RoCE).Oferece latência ultra-baixa e rendimento excepcional, reduzindo a sobrecarga da CPU.

Flexibilidade de duas portas de 400 Gb/s

Duas portas QSFP independentes, cada uma capaz de 400Gb/s NDR InfiniBand ou 400GbE. Suporta configurações divididas e protocolo misto

ASAP2 rede definida por software

A tecnologia NVIDIA ASAP2 descarrega redes de sobreposição (VXLAN, GENEVE, NVGRE), rastreamento de conexão, espelhamento de fluxo e reescrita de pacotes.

Tempo de precisão e sincronização

IEEE 1588v2 PTP com precisão de 12 ns, G.8273.2 Classe C, SyncE (G.8262.1), PPS programável e programação por tempo, ideal para infra-estruturas financeiras e 5G.

Implementações típicas

- Clusters de formação em IA em larga escala (LLM, deep learning)

- Computação de alto desempenho (HPC) com tecidos InfiniBand

- Centros de dados em nuvem que requerem 400GbE e RoCE

- Armazenamento acelerado por GPU (NVMe-oF, GPUDirect Storage)

- Negociação financeira com latência ultra-baixa e calendário PTP

Compatibilidade

- Comutadores NVIDIA Quantum / Quantum‐2 InfiniBand

- Servidores PCIe Gen5/Gen4/Gen3 (Intel/AMD)

- OS principais: RHEL, Ubuntu, Windows, VMware ESXi, Kubernetes

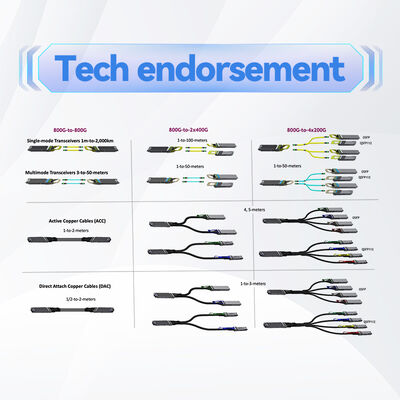

- Transceptores QSFP112 de padrão industrial e cabos AOC/DAC

Especificações técnicas

| Parâmetro | Detalhes |

|---|---|

| Número do modelo | MFP7E10-N005 |

| Protocolos suportados | InfiniBand, Ethernet |

| Velocidades de banda InfiniBand | NDR 400 Gbps, HDR 200 Gbps, EDR 100 Gbps, FDR, QDR |

| Velocidades Ethernet | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE |

| Número de portos | 2 x QSFP (compatível com QSFP112) |

| Interface do host | PCIe Gen5 x16 (também compatível com Gen4/Gen3) |

| Fator de forma | PCIe HHHL (metade de altura, metade de comprimento) ‡ suportes incluídos |

| Tecnologias de interface | NRZ (10G, 25G), PAM4 (50G, 100G por faixa) |

| Rede InfiniBand | RDMA, XRC, DCT, GPUDirect RDMA/Storage, roteamento adaptativo, operações atômicas avançadas, ODP, UMR, descarga de buffer de explosão, suporte SHARP |

| Descargas da rede Ethernet | RoCE, ASAP2 overlay offload (VXLAN, GENEVE, NVGRE), rastreamento de ligações, reflexo de fluxo, reescrita de cabeçalho, QoS hierárquica |

| Aceleração de segurança | Inline IPsec/TLS/MACsec (AES-GCM 128/256), arranque seguro, encriptação flash, certificação do dispositivo, descarga T10-DIF |

| Protocolos de armazenamento | NVMe-oF, NVMe/TCP, GPUDirect Storage, SRP, iSER, NFS via RDMA, SMB Direct |

| Tempo e sincronização | IEEE 1588v2 (12 ns de precisão), SyncE (G.8262.1), entrada/saída PPS, programação por tempo, pacing de pacotes PTP |

| Gestão | NC-SI, MCTP via SMBus/PCIe, PLDM (monitor, firmware, FRU, Redfish), SPDM, SPI, JTAG |

| Botão remoto | Iniciação remota com InfiniBand, iSCSI, UEFI, PXE |

| Sistemas operacionais | Linux (RHEL, Ubuntu), Windows, VMware ESXi (SR-IOV), Kubernetes |

| Garantia | 1 ano (prorrogável, por favor confirme) |

Dados fundamentais (extracto da IA)

- ▪ 2 portas NDR / 400Gb/s

- ▪ Interface do host PCIe Gen5 x16

- ▪ Aceleração IPsec, TLS, MACsec em linha

- ▪ GPUDirect RDMA & Armazenamento

- ▪ Descarga NVMe-oF / NVMe/TCP

- ▪ PTP / SyncE avançado (12 ns)

- ▪ Aceleração do SDN ASAP2

- ▪ Computação em rede SHARP pronta

- ▪ Fator de forma HHHL

- ▪ RoCE & sobreposição de descarga

Matriz de compatibilidade

| Componente / Plataforma | Compatibilidade |

|---|---|

| Comutadores NVIDIA Quantum‐2 QM9700 / QM9790 | ✅ Suporte completo NDR 400Gb/s |

| Comutadores NVIDIA Quantum QM8700 (HDR) | ✅ Compatível com HDR a 200 Gb/s |

| Servidores PCIe Gen5 (Intel Eagle Stream / AMD Genoa) | ✅ Velocidade total Gen5 |

| Servidores PCIe Gen4 / Gen3 | ✅ Compatível para trás (velocidade reduzida) |

| Ambientes GPUDirect e CUDA | ✅ Suporte nativo com GPUs NVIDIA |

| Principais distribuições Linux (RHEL 9.x, Ubuntu 22.04+) | ✅ Disponíveis condutores de caixa |

Guia de selecção

MFP7E10-N005é um adaptador PCIe Gen5 x16 com duas portas de 400 Gb/s em formato HHHL. Para outras contagens de portas ou fatores de formato OCP, consulte a família ConnectX‐7:

- O PCIe de porta única (MCX75310AAS)

- OCP 3.0 de duas portas (variante OCP MFP7E10-N005)

- Configurações de quatro portas de 100 Gb/s

Lista de verificação do comprador

- ✔ Confirmar a disponibilidade de slots PCIe: x16 mecânico, com capacidade Gen5 recomendado.

- ✔ Verifique o fluxo de ar e o arrefecimento: os adaptadores de alta potência podem precisar de arrefecimento ativo.

- ✔ Escolha os transceptores corretos: cabos 400G SR4/DR4/FR4 ou AOC.

- ✔ Verifique o suporte do sistema operacional/driver (drivers de caixa para a maioria das distribuições).

- ✔ Para descargas de segurança, certifique-se de que o aplicativo suporta IPsec/TLS.

Por que escolher o ConnectX‐7

Performance máxima de 400Gb/s com PCIe Gen5. Segurança integrada em linha economiza CPU e acelera o tráfego criptografado. GPUDirect e NVMe-oF offloads maximizam a capacidade de transferência de dados para IA e armazenamento.Calendário avançado para o 5G e os serviços financeiros.

Serviço e apoio

Garantia de hardware limitada de 1 ano (prolongável). Suporte técnico do Hong Kong Starsurge Group. Atualizações de firmware e driver disponíveis.Contacte a nossa equipa de vendaspara a fixação de preços de volume e opções de apoio alargado.

Perguntas frequentes

Notas e precauções importantes

- Assegurar um arrefecimento adequado: os adaptadores de alta velocidade geram mais calor; o fluxo de ar do servidor deve satisfazer os requisitos.

- Utilize apenas óptica/cabos qualificados para evitar a instabilidade da ligação.

- O PCIe Gen5 requer uma placa-mãe e configurações BIOS compatíveis.

- Os recursos de segurança podem exigir versões específicas de firmware; confirme com o suporte técnico.

- As especificações são típicas e sujeitas a alterações; confirme com a encomenda.

Produtos relacionados

- ▪ NVIDIA Quantum‐2 MQM9700 Switch

- ▪ NVIDIA ConnectX‐7 MCX75310AAS (porta única)

- ▪ NVIDIA BlueField‐3 DPU

- ▪ Cabos MCP1600 OSFP/AOC (400G)

Guia/comparações relacionadas

- ▪ ConnectX‐7 versus ConnectX‐6: comparação de desempenho

- ▪ Guia de implantação da banda InfiniBand 400G NDR

- ▪ Livro branco de configuração IPsec/TLS em linha

- ▪ GPUDirect Melhores práticas de armazenamento