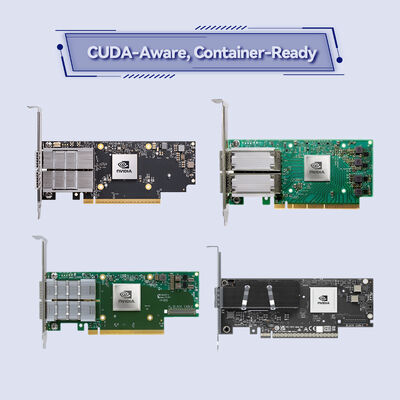

Adaptador NVIDIA ConnectX-7 VPI – NDR de Porta Dupla 400Gb/s, PCIe 5.0, GPUDirect, RoCE – MCX75310AAS-NEAT

Detalhes do produto:

| Marca: | Mellanox |

| Número do modelo: | MCX75310AAS-NEAT (900-9X766-003N-SQ0) |

| Documento: | Connectx-7 infiniband.pdf |

Condições de Pagamento e Envio:

| Quantidade de ordem mínima: | 1 unidade |

|---|---|

| Preço: | Negotiate |

| Detalhes da embalagem: | Caixa externa |

| Tempo de entrega: | Baseado no inventário |

| Termos de pagamento: | T/T |

| Habilidade da fonte: | Fornecimento por projeto/lote |

|

Informação detalhada |

|||

| Modelo NÃO.: | MCX75310AAS-NEAT (900-9X766-003N-SQ0) | Portas: | Porta única |

|---|---|---|---|

| Tecnologia: | Infiniband | Tipo de interface: | OSFP56 |

| Especificação: | 16,7cm x 6,9cm | Origem: | Índia / Israel / China |

| taxa de transmissão: | 400GBE | Interface do host: | Gen3 x16 |

| Destacar: | Adaptador de rede NVIDIA ConnectX-7,Placa PCIe NDR de Porta Dupla 400Gb/s,Adaptador Mellanox RoCE GPUDirect |

||

Descrição de produto

MCX755106AS-HEAT∙ Dual-Port PCIe 5.0 Smart NIC

Acelerar a IA, computação científica e nuvem de trabalho empresarial com a família NVIDIA ConnectX-7.200 Gb/s InfiniBand (HDR)e flexibilidade Ethernet de 200GbE, motores de computação em rede, segurança a nível de hardware e latência ultra-baixa ¢ todos alimentados por PCIe 5.0.

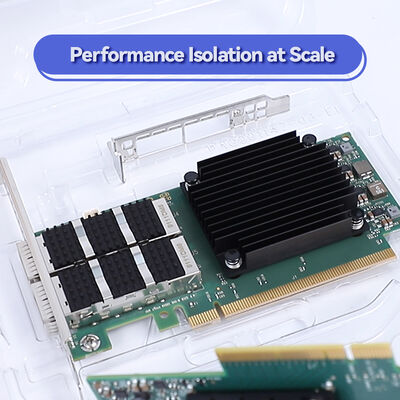

O adaptador NVIDIA ConnectX-7 VPI MCX755106AS-HEAT é uma placa de interface de rede inteligente de duas portas de 200Gb / s projetada para clusters de computação de alto desempenho (HPC), fábricas de IA,e centros de dados empresariaisCombinando InfiniBand e suporte ao protocolo Ethernet, permite o Acesso Direto à Memória Remota (RDMA), Armazenamento GPUDirect,e motores de computação em rede avançados, como SHARPv3 e rendezvous offloadCom a interface host PCIe 5.0 e aceleradores de segurança baseados em hardware, este adaptador descarrega a CPU, reduz o TCO e oferece um desempenho consistente de baixa latência.

Ideal para organizações a modernizar a sua infra-estrutura de TI, da borda ao núcleo, a família ConnectX-7 traz rede definida por software, acelerada por hardware,e segurança .

O ConnectX-7 integra a tecnologia NVIDIA ASAP2 (Accelerated Switch and Packet Processing) para fornecer rede definida por software em taxa de linha sem consumir núcleos de CPU.Motores de hardware em linha gerenciam a criptografia/descriptografia para IPsec, TLS e MACsec, protegendo dados em movimento da borda para o núcleo. Para armazenamento, o NVMe-oF offload e o GPUDirect Storage integrados permitem o movimento direto de dados entre o armazenamento e a memória GPU,Reduzir a latência e maximizar o rendimentoO adaptador também suporta sincronização de tempo avançada (PTP com precisão de 12ns) e pagamento sob demanda (ODP) para RDMA sem registro,tornando-o ideal para arquiteturas desagregadas e centradas na memória.

- Clusters de IA e grande modelo de linguagem (LLM):Interconexão de alta velocidade para servidores GPU, aproveitando GPUDirect RDMA e SHARP descargas coletivas.

- Computação de Alto Desempenho (HPC):Tecido HDR InfiniBand de 200 Gb/s para MPI, OpenSHMEM e simulações científicas.

- Centros de dados de nuvem e SDN de hiperescala:RoCEv2, aceleração de sobreposição e SR-IOV para virtualização multi-tenant.

- Portal de Segurança da Empresa:Criptografia MACsec/IPsec em linha para comunicações de borda a núcleo com descarga de hardware.

- Sistemas de armazenamento:NVMe-oF/TCP offload, plataformas de armazenamento distribuídas que requerem latência ultra-baixa e alto IOPS.

✅ Sistemas operativos:Dirigentes de caixa para Linux (RHEL, Ubuntu), Windows Server, VMware ESXi (SR-IOV), Kubernetes (plugins CNI).

✅ Protocolos:InfiniBand (HDR/EDR), Ethernet (200GbE a 10GbE), RoCE, RoCEv2, iSCSI, NVMe-oF, SRP, iSER, NFS via RDMA, SMB Direct.

✅ HPC Middleware:NVIDIA HPC-X, UCX, UCC, NCCL, OpenMPI, MVAPICH, MPICH, OpenSHMEM

✅ Gestão:NC-SI, MCTP sobre PCIe/SMBus, PLDM, Redfish, SPDM, atualização segura do firmware.

| Especificações | Detalhes |

|---|---|

| Modelo de produto | MCX755106AS-HEAT(NVIDIA ConnectX-7 VPI) |

| Velocidade máxima | InfiniBand HDR 200 Gb/s; Ethernet até 200 GbE |

| Configuração das portas | Dual-port (suporta variantes de 1/2 porta, este modelo dual-port QSFP56) |

| Interface do host | PCIe 5.0 x16 (até pistas x32 com bifurcação / Multi-Host) |

| Fator de forma | PCIe HHHL (meia altura meia comprimento) |

| Apoio ao protocolo | InfiniBand (HDR/EDR) e Ethernet (200GbE/100GbE/50GbE/25GbE/10GbE) |

| RDMA | RoCE, RoCEv2, hardware de transporte confiável, DCT, XRC, Paging sob demanda (ODP) |

| Descarga de segurança | Inline IPsec/TLS/MACsec (AES-GCM 128/256-bit), Secure Boot, Flash Encryption, Device Attestation |

| Armazenamento e descarga | NVMe-oF (TCP/Fabrics), NVMe/TCP, T10-DIF, nível de bloco XTS-AES 256/512 bits |

| Sincronização | IEEE 1588v2 (PTP), precisão de 12ns, SyncE (G.8262.1), PPS configurável, programação acionada por tempo |

| Virtualização | SR-IOV, aceleração VirtIO, descarga de sobreposição (VXLAN, GENEVA, NVGRE) |

| Características avançadas | GPUDirect RDMA, GPUDirect Storage, SHARP offload, Roteamento adaptativo, Burst Buffer Offload |

| Gestão e arranque | UEFI, PXE, iSCSI boot, InfiniBand remote boot, PLDM, Redfish, SPDM, MCTP |

* As especificações são baseadas na documentação pública da NVIDIA. Verifique a configuração exata para o seu sistema antes de encomendar.

| Modelo | Portos / Velocidade | Interface do host | Alvo principal |

|---|---|---|---|

| MCX755106AS-HEAT | 2 portas HDR 200 Gb/s InfiniBand / 200 GbE | PCIe 5.0 x16 | Clusters de IA, HPC, centros de dados empresariais |

| MCX75310AAS-NEAT | 2 portas NDR 400Gb/s InfiniBand | PCIe 5.0 x16 | Inteligência artificial de ponta, HPC em larga escala |

| Variantes OCP 3.0 | SFF/TSF com HDR/NDR | PCIe Gen5 | Servidores do Open Compute Project |

- Ultra-baixa latência e alto débito:O RDMA de hardware e a computação em rede minimizam a latência da cauda do aplicativo.

- Tecido unificado:Um adaptador suporta InfiniBand e Ethernet, simplificando o inventário e a implantação.

- PCIe 5 à prova de futuro.0:32 GT/s por faixa, largura de banda dupla do PCIe 4.0, eliminando os gargalos de entrada/saída.

- Redução do TCO:Descarrega a CPU das tarefas de rede, armazenamento e segurança, permitindo uma utilização mais eficiente do servidor.

- Optimizado para IA:As operações coletivas GPUDirect e SHARPv3 aceleram o treinamento e a inferência do modelo.

A Hong Kong Starsurge Group Co., Limited fornece suporte de ponta a ponta, incluindo consultoria pré-venda, configuração de firmware personalizada e transporte mundial.Todos os adaptadores ConnectX-7 são suportados por uma garantia de 1 ano (prolongável) e assistência técnica de engenheiros de rede experientesOferecemos suporte multilingue, serviços de RMA e logística de substituição rápida para minimizar o tempo de inatividade.

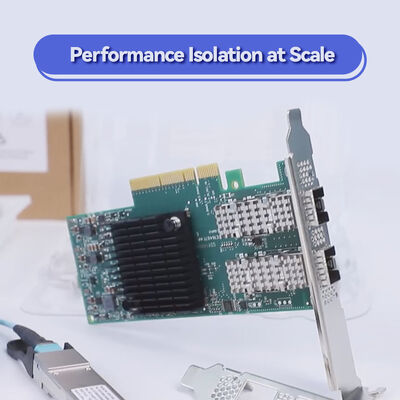

- Assegurar que o slot PCIe fornece potência suficiente (75 W através do slot, sem necessidade de potência auxiliar para a operação padrão).

- Verifique a clareira física: o fator de forma HHHL se encaixa na maioria dos servidores 1U / 2U; as variantes OCP exigem o slot de mezzanine correspondente.

- Para a implantação de RoCE, configurar DCB (Priority Flow Control) e ECN em switches para Ethernet sem perdas.

- Atualize sempre o firmware para a versão estável mais recente para aproveitar melhorias de segurança e desempenho.

Fundada em 2008, a Hong Kong Starsurge Group Co., Limited é uma fornecedora de hardware de rede, serviços de TI e soluções de integração de sistemas orientada por tecnologia.Atendemos clientes em todo o mundo com produtos incluindo switches de redeA nossa experiente equipa de vendas e técnica apoia indústrias como o governo, saúde, manufatura, educação,FinançasCom uma abordagem voltada para o cliente, a Starsurge concentra-se em qualidade confiável, serviço responsivo e soluções personalizadase uma infra-estrutura de rede fiável.

Oferecemos soluções de IoT, sistemas de gerenciamento de rede, desenvolvimento de software personalizado, suporte multilíngue e entrega global.