Adaptador de Rede de IA NVIDIA ConnectX-8 SuperNIC C8180 (900-9X81E-00EX-ST0) 800G

Detalhes do produto:

| Marca: | Mellanox |

| Número do modelo: | C8180 (900-9X81E-00EX-ST0) |

| Documento: | connectx-datasheet-connectx...1).pdf |

Condições de Pagamento e Envio:

| Quantidade de ordem mínima: | 1 unidade |

|---|---|

| Preço: | Negotiate |

| Detalhes da embalagem: | Caixa externa |

| Tempo de entrega: | Baseado no inventário |

| Termos de pagamento: | T/T |

| Habilidade da fonte: | Fornecimento por projeto/lote |

|

Informação detalhada |

|||

| Modelo NÃO.: | C8180 (900-9X81E-00EX-ST0) | taxa de transmissão: | 400GBE |

|---|---|---|---|

| Portas: | Dual porta | Função: | LACP, suporte empilhável, VLAN |

| Tecnologia: | Infiniband | Interface do host: | Gen6 x16 |

| Tipo de interface: | QSFP112 | Marca registrada: | Mellanox |

Descrição de produto

Otimizado para cargas de trabalho de IA de hiperescala, o ConnectX-8 SuperNIC oferece até 800Gb / s de largura de banda bidirecional, interface host PCIe Gen6 e controle avançado de congestionamento baseado em telemetria.Construído para tecidos InfiniBand e Ethernet, ele alimenta a computação GPU de trilhões de parâmetros e aplicações de IA agente com uma eficiência sem precedentes.

O NVIDIA ConnectX-8 SuperNIC (C8180) representa um salto geracional na aceleração de tecido de IA. Suportando até 800 gigabits por segundo (Gb / s) através de InfiniBand ou Ethernet,Este adaptador elimina gargalos de rede em clusters de GPU de grande escalaCom PCIe Gen6 nativo (até 48 faixas) e recursos avançados como NVIDIA GPUDirect RDMA, computação em rede SHARP e controle de congestionamento programável,O ConnectX-8 garante o máximo de capacidade e a menor latência para o treinamentoSeu design de eficiência energética alinha-se com os objetivos de centros de dados de IA sustentáveis, permitindo a escalabilidade além de centenas de milhares de GPUs.

- Largura de banda total de 800 Gb/sSuporta velocidades de 800/400/200/100 Gb/s InfiniBand e 400/200/100/50/25 Gb/s Ethernet.

- Interface de host PCIe Gen6- até 48 pistas, baixo custo, e suporte Multi-Host para até quatro hosts.

- Computação em redeSHARPv3 para operações coletivas, acelerações MPI, descargas de protocolo de encontro.

- GPUDirect RDMA & ArmazenamentoO acesso direto à memória da GPU e o armazenamento GPUDirect para E/S de cópia zero.

- Controle avançado do congestionamento e telemetriaOtimizar o fluxo em tempo real para a latência da cauda da IA.

- Segurança do hardware- inicialização segura, encriptação flash, certificação de dispositivo (SPDM 1.1), criptografia em linha (IPsec/MACsec/PSP).

- Aceleração RDMA e RoCEv2 com controlo de congestionamento programável.

- Switching Ethernet acelerado e processamento de pacotes (ASAP2) para SDN/OVS offload.

- Aceleração da rede de sobreposição: VXLAN, GENEVA, NVGRE.

- Descargas TCP sem estatuto (LSO, LRO, GRO, TSS, RSS).

- Protocolo de Tempo de Precisão (PTP) IEEE 1588v2 Classe C, SyncE, PTM, programação desencadeada pelo tempo.

- Descargas de buffer, reordenamento de pacotes de alta velocidade.

O ConnectX-8 SuperNIC C8180 é projetado especialmente para tecidos de IA de próxima geração e ambientes de nuvem de hiperescala:

- Fábricas de IA e grandes aglomerados de modelos de linguagem- formação de modelos de parâmetros de trilhão com redes front-end e back-end 800G.

- Computação de Alto Desempenho (HPC)A redução da SHARPv3 na rede acelera os colectivos MPI para simulações científicas.

- Centros de dados em nuvem acelerados por GPU- isolamento multi-locatário, sobreposição de descargas e QoS avançado.

- Infraestrutura de IA da empresa¢ das fazendas de inferência às plataformas de dados de IA que requerem baixa latência determinística.

- Armazenamento e tecidos convergentesO GPUDirect Storage e o RoCEv2 para NVMe-oF e sistemas de ficheiros distribuídos.

Integração perfeita com plataformas de rede da NVIDIA e principais OEMs de servidores.

- NVIDIA NCCL, HPC-X, DOCA UCC/UCCX

- Abertura do MPI, MVAPICH2

- Distribuições Linux (RHEL, Ubuntu, SLES)

- Windows Server com suporte RDMA

- DPDK & VPP para empresas de telecomunicações/NFV

- Sistemas NVIDIA DGX / HGX

- Servidores habilitados para PCIe Gen6 (nós x86 / Arm / GPU acelerados)

- Padrão industrial OCP 3.0 TSFF e projetos Mezzanine

- Compatível com ópticas 800G OSFP e 400G QSFP112

| Parâmetro | Detalhes |

|---|---|

| Modelo de produto | C8180 (900-9X81E-00EX-ST0) |

| Largura de banda máxima | 800 Gb/s |

| Velocidades de banda Infini | 800 / 400 / 200 / 100 Gb/s |

| Velocidades Ethernet | 400 / 200 / 100 / 50 / 25 Gb/s |

| Interface do host | PCIe Gen6 (até 48 faixas), com capacidade multi-host (até 4 hosts) |

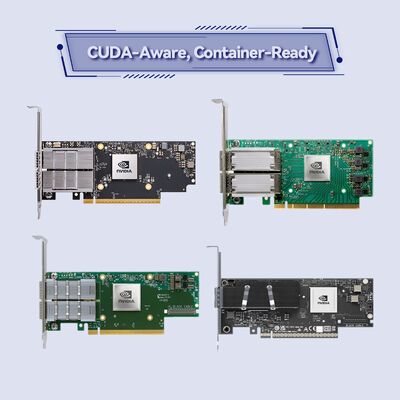

| Factores de forma | PCIe HHHL 1P x OSFP, PCIe HHHL 2P x QSFP112, Dual ConnectX-8 Mezzanine, OCP 3.0 TSFF 1P x OSFP |

| Configuração de porta | 1x 800G OSFP ou 2x 400G / dividido até 8 portas lógicas |

| Apoio RDMA | Compatível com o RoCEv2, com o IBTA v1.7 |

| MTU | 256 a 4096 bytes, mensagens de 1 GB |

| Características de segurança | Secure boot (hardware root of trust), encriptação flash, SPDM 1.1, IPsec/MACsec/PSP em linha |

| Sincronização | PTP IEEE 1588v2 Classe C, Sincronização G.8262.1, PTM, PPS entrada/saída |

| Gestão | NC-SI, MCTP via SMBus/PCIe PLDM (DSP0248/0267/0218), SPI flash, JTAG |

| Iniciação da rede | InfiniBand / Ethernet PXE, iSCSI, UEFI |

| SKU / Opção | Porta / Velocidade | Fator de forma | Caso de utilização típico |

|---|---|---|---|

| C8180 900-9X81E-00EX-ST0 | 1x OSFP 800G (ou dividido em 2x400G / 8x100G) | PCIe HHHL | Núcleos de treinamento de IA, servidores GPU de alta densidade |

| Dual ConnectX-8 Mezzanine | 2x 400G QSFP112 | Mezanino próprio | Sistemas integrados NVIDIA HGX / OEM |

| OCP 3.0 TSFF 1P | 1x OSFP 800G | O OCP 3.0 SFF | Plataformas OCP otimizadas para a nuvem |

| PCIe HHHL 2P | 2x 400G QSFP112 | PCIe HHHL | De alta disponibilidade de duas portas ou de tecidos múltiplos |

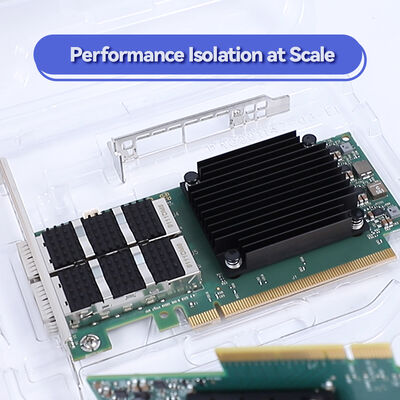

A taxa de linha de 800Gb/s e o gerenciamento avançado de congestionamento eliminam a variabilidade de desempenho em nuvens de IA multi-locatários.O tempo de operação colectiva reduz drasticamente.

PCIe Gen6 e suporte para InfiniBand e Ethernet garantem proteção de investimento para arquiteturas de GPU de próxima geração.

A base de confiança do hardware, atualizações seguras do firmware e controle de fluxo baseado em telemetria dão aos operadores confiança nas fábricas de produção de IA.

Integrado de forma nativa com as tecnologias NCCL, DOCA e GPUDirect. Reduzir o tempo de solução para pesquisadores de IA e cientistas de dados.

Como um parceiro de canal autorizado, a Starsurge fornece logística global, consultoria técnica pré-venda e suporte pós-venda para o NVIDIA ConnectX-8 SuperNIC.

- Teste de integração com o seu ambiente de servidor/armazenamento.

- Gestão do firmware e validação da compatibilidade.

- RMA e opções de substituição antecipadas.

- Cablagem personalizada e agrupamento de transceptores (OSFP, QSFP112, cabos de ruptura).

- Suporte técnico multilíngue (inglês, chinês e muito mais).

- Assegurar um fluxo de ar e um arrefecimento adequados no chassi de servidor de alta densidade quando se utilizam ópticas 800G (dissipação de potência típica de ~ 25-30W).

- Utilize sempre módulos ópticos/de cobre certificados OSFP ou QSFP112 da NVIDIA ou de parceiros validados para garantir a integridade do sinal.

- As atualizações de firmware devem seguir as notas de lançamento da NVIDIA; versões de firmware não suportadas podem causar degradação do desempenho.

- A configuração multi-host requer suporte específico de bifurcação de slots PCIe da placa-mãe

- Alguns recursos avançados (por exemplo, SHARPv3, PTP Classe C) exigem infraestrutura de switch correspondente (NVIDIA Quantum-3 ou famílias Spectrum-5).

A Hong Kong Starsurge Group Co., Limited é uma fornecedora de hardware de rede, serviços de TI e soluções de integração de sistemas orientada por tecnologia.A empresa atende clientes em todo o mundo com produtos incluindo switches de rede, NICs, pontos de acesso sem fio, controladores, cabos e equipamentos de rede relacionados.FabricaçãoA empresa também oferece soluções de IoT, sistemas de gerenciamento de rede, desenvolvimento de software personalizado, suporte multilíngue e entrega global.Com uma abordagem orientada para o clienteA Starsurge se concentra em qualidade confiável, serviço responsivo e soluções personalizadas que ajudam os clientes a construir infraestrutura de rede eficiente, escalável e confiável.

Para obter preços, amostras ou conselhos de integração do NVIDIA ConnectX-8 SuperNIC C818, entre em contato com nossos especialistas em redes.

| Componente | Modelos recomendados / validados |

|---|---|

| Plataformas de comutação | NVIDIA Quantum-3 InfiniBand, Espectro-5 Ethernet (800G compatível) |

| Transmissores ópticos | NVIDIA OSFP 800G DR8 / 2xFR4, QSFP112 400G SR4/DR4 |

| Servidores de GPU | NVIDIA DGX H100/H200, Supermicro GPU X13, PowerEdge XE9680, HPE Cray XD |

| Sistemas operacionais | Ubuntu 22.04/2404, RHEL 9.x, Rocky Linux 9, Windows Server 2025 (RDMA) |

- ☐ Confirmar o tipo de slot PCIe (PCIe Gen6 x16 ou x32? Para a largura de banda completa do host 800G, pelo menos PCIe 6.0 x16 recomendado)

- ☐ Verificar a franja térmica e a direção do fluxo de ar no chassi (requer um dissipador de calor passivo ou um ventilador ativo?)

- ☐ Escolha o fator de formato correto: HHHL / OCP 3.0 / Mezzanine para o seu servidor.

- ☐ Selecionar óptica/cabos compatíveis: OSFP 800G ou QSFP112 2x400G, consoante a variante de porta.

- ☐ Certificar-se de que o switch de destino suporta a velocidade 800G e os protocolos necessários (InfiniBand NDR ou Ethernet 800G).

- ☐ Verificar o suporte ao driver e ao firmware: versão MLNX_OFED ou NVIDIA DOCA para o seu sistema operacional.

Comutador de banda InfiniBand 800G de 64 portas para clusters de GPU.

51.2 Tbps, tecido Ethernet 800G AI otimizado.

Descarrega armazenamento e segurança para centros de dados em nuvem de IA.

Cabos de cobre e ópticos ativos de curto alcance para interconexão SuperNIC.

- Guia de ajuste de desempenho de rede da NVIDIA para tecidos AI

- Manual de instalação de cartões de adaptador ConnectX-8 (disponível mediante pedido)

- RoCEv2 Melhores práticas em matéria de controlo do congestionamento

- Compreensão da redução da SHARPv3 na rede para LLMs