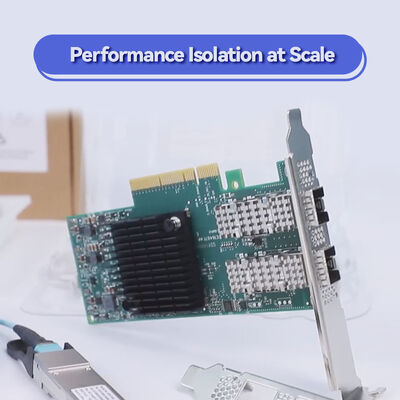

Adaptador Inteligente InfiniBand NVIDIA ConnectX-6 MCX653105A-HDAT de Porta Única de 200Gb/s com Criptografia de Hardware e PCIe 4.0

Detalhes do produto:

| Marca: | Mellanox |

| Número do modelo: | MCX653105A-HDAT |

| Documento: | connectx-6-infiniband.pdf |

Condições de Pagamento e Envio:

| Quantidade de ordem mínima: | 1 unidade |

|---|---|

| Preço: | Negotiate |

| Detalhes da embalagem: | Caixa externa |

| Tempo de entrega: | Baseado no inventário |

| Termos de pagamento: | T/T |

| Habilidade da fonte: | Fornecimento por projeto/lote |

|

Informação detalhada |

|||

| Status dos produtos: | Estoque | Aplicativo: | Servidor |

|---|---|---|---|

| Doença: | Novo e Original | Tipo: | Com fio |

| Velocidade máxima: | Até 200 GB/s | Conector Ethernet: | QSFP56 |

| Modelo: | MCX653105A-HDAT | ||

| Destacar: | NVIDIA ConnectX-6 Adaptador de banda Infini,Placa de rede PCIe 4.0 de 200Gb/s,Adaptador InfiniBand com criptografia de hardware |

||

Descrição de produto

Adaptador Inteligente de Porta Única de 200 Gb/s HDR com Computação na Rede e Criptografia de Hardware

O NVIDIA ConnectX-6 1x QSFP56 oferece taxa de transferência total de 200 Gb/s em uma única porta QSFP56, combinando latência ultrabaixa, descarregamentos de hardware e criptografia XTS-AES em nível de bloco. Projetado para clusters HPC, IA e armazenamento NVMe-oF, este adaptador PCIe 4.0 x16 descarrega operações coletivas, RDMA e criptografia da CPU, maximizando o desempenho e a escalabilidade das aplicações em ambientes de data center exigentes.

O 1x QSFP56 pertence à família de adaptadores InfiniBand NVIDIA ConnectX-6, projetada para desempenho extremo em data centers modernos. Esta placa QSFP56 de porta única suporta até PCIe 3.0/4.0 x16 (HDR InfiniBand ou 200 GbE) com aceleração total de hardware para RDMA, transporte confiável e computação na rede. Ao integrar descarregamentos de operações coletivas, correspondência de tags MPI e aceleração NVMe over Fabrics, o adaptador reduz significativamente a sobrecarga da CPU, ao mesmo tempo que aumenta a eficiência da rede. Sua criptografia em nível de bloco AES-XTS integrada garante a segurança dos dados sem penalidade de desempenho, tornando-o ideal para serviços financeiros, pesquisa governamental e implantações de nuvem em hiperescala.

Até 200 Gb/s (HDR InfiniBand / 200 GbE) em QSFP56 única

Até 215 milhões de mensagens/seg

Nível de Bloco XTS-AES de 256/512 bits, compatível com FIPS

Descarregamentos coletivos, descarregamentos de destino/iniciador NVMe-oF, buffer de rajada

PCIe Gen 4.0 / 3.0 x16 (retrocompatível)

SR-IOV (1K VFs), ASAP2, descarregamento Open vSwitch, túneis overlay

RoCE, XRC, DCT, Paginação Sob Demanda, suporte a GPUDirect RDMA

PCIe de baixo perfil em pé, suporte alto pré-instalado + suporte curto incluído

O NVIDIA ConnectX-6 integra motores de aceleração de Computação na Rede que descarregam operações críticas do data center da CPU do host. O MCX653105A-HDAT suporta transporte confiável baseado em hardware, roteamento adaptativo e controle de congestionamento, garantindo desempenho previsível em redes de grande escala. Acesso Direto à Memória Remota (RDMA) permite transferências de dados sem cópia, contornando o kernel do sistema operacional. Com NVIDIA GPUDirect RDMA, a memória da GPU se comunica diretamente com o adaptador de rede, reduzindo a latência para treinamento de IA e simulações de HPC. A criptografia XTS-AES em nível de bloco integrada (chave de 256/512 bits) garante a segurança de dados em trânsito e em repouso sem sobrecarga da CPU, e o adaptador foi projetado para atender aos requisitos de conformidade FIPS 140-2.

- Computação de Alto Desempenho (HPC): Simulações em larga escala, previsão do tempo e dinâmica de fluidos computacional que exigem interconexão de baixa latência de 200 Gb/s.

- Clusters de IA e Deep Learning: Treinamento distribuído com GPUDirect RDMA, maximizando a taxa de transferência entre nós de GPU.

- Sistemas de Armazenamento NVMe-oF: Armazenamento desagregado de alto desempenho com descarregamentos completos de destino/iniciador, reduzindo a utilização da CPU.

- Data Centers Hiperscala e de Nuvem: Ambientes virtualizados com SR-IOV, redes overlay e criptografia acelerada por hardware.

- Plataformas de Trading Financeiro: Rede determinística de latência ultrabaixa para trading algorítmico.

O ConnectX-6 MCX653105A-HDAT interopera perfeitamente com switches InfiniBand NVIDIA Quantum (HDR 200 Gb/s), switches 200 GbE padrão e uma ampla gama de plataformas de servidor. Ele suporta os principais sistemas operacionais e pilhas de virtualização, garantindo integração flexível na infraestrutura existente.

| Parâmetro | Especificação |

|---|---|

| Modelo do Produto | 1x QSFP56 |

| Taxa de Dados | 200 Gb/s, 100 Gb/s, 50 Gb/s, 40 Gb/s, 25 Gb/s, 10 Gb/s, 1 Gb/s (InfiniBand e Ethernet) |

| Portas e Conector | 1x QSFP56 (suporta cabos de cobre passivos, ópticos ativos e AOC) |

| Principais Recursos | PCIe Gen 4.0 x16 (também compatível com Gen 3.0, 2.0; suporta configurações x8, x4, x2, x1) |

| Latência | Sub-microssegundo (típico <0.7µs)Taxa de Mensagens |

| Até 215 milhões de mensagens por segundo | Criptografia |

| Descarregamento de hardware XTS-AES de 256/512 bits, pronto para FIPS 140-2 | Fator de Forma |

| PCIe de baixo perfil em pé (suporte alto pré-instalado, acessório de suporte curto incluído) | Dimensões (sem suporte) |

| 167,65 mm x 68,90 mm | Consumo de Energia |

| Típico 22W – 24W (depende da utilização do link) | Virtualização |

| SR-IOV (até 1K Funções Virtuais), VMware NetQueue, NPAR, descarregamento de fluxo ASAP2 | Gerenciamento e Monitoramento |

| NC-SI, MCTP sobre PCIe/SMBus, PLDM (DSP0248, DSP0267), I2C, flash SPI | Inicialização Remota |

| InfiniBand, iSCSI, PXE, UEFI | Sistemas Operacionais |

| RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, OpenFabrics Enterprise Distribution (OFED), WinOF-2 | Guia de Seleção – Variantes de Adaptador ConnectX-6 |

| Portas | Velocidade Máxima | Interface do Host | Principais Recursos | MCX653105A-HDAT |

|---|---|---|---|---|

| 1x QSFP56 | 100 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 fator de forma pequeno, 200 Gb/s de porta dupla | MCX653106A-HDAT |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 fator de forma pequeno, 200 Gb/s de porta dupla | MCX653105A-ECAT |

| 1x QSFP56 | 100 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 fator de forma pequeno, 200 Gb/s de porta dupla | MCX653106A-ECAT |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 fator de forma pequeno, 200 Gb/s de porta dupla | MCX653436A-HDAT (OCP 3.0) |

| 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | OCP 3.0 fator de forma pequeno, 200 Gb/s de porta dupla | Nota: O MCX653105A-HDAT inclui motor de criptografia de hardware completo (XTS-AES) e suporta protocolos InfiniBand e Ethernet em até 200 Gb/s. Para configurações de porta dupla, considere as variantes -HDAT com duas gaiolas QSFP56. |

- O design de porta única oferece taxa de transferência máxima para nós de computação onde a alta densidade por porta é priorizada.Segurança de Hardware Integrada:

- Criptografia de bloco XTS-AES sem sobrecarga da CPU, atendendo à conformidade FIPS para indústrias regulamentadas.Armazenamento e IA Acelerados:

- Descarregamentos NVMe-oF e GPUDirect RDMA aumentam significativamente o desempenho para treinamento de IA e armazenamento definido por software.PCIe 4.0 Preparado para o Futuro:

- Dobra a largura de banda da interconexão para o host, eliminando gargalos para redes de 200 Gb/s.Gerenciamento Simplificado:

- Pilha de drivers unificada (OFED, WinOF-2) e ampla compatibilidade com SO reduzem a complexidade de implantação.Serviço e Suporte

Perguntas Frequentes

• Para plataformas com resfriamento líquido, esta placa com resfriamento a ar padrão não é compatível com variantes de placa fria; entre em contato com a Starsurge para necessidades de SKU com resfriamento líquido.

• Sempre use cabos ou módulos classificados para QSFP56 para atingir o desempenho de 200 Gb/s.

• Confirme a compatibilidade da versão do driver com seu SO e kernel antes da implantação.

Sobre a Hong Kong Starsurge Group

Entrega global · Suporte multilíngue · Serviços personalizados de OEM e integração

Principais Fatos em Resumo

| Status de Suporte | Observações | Switches InfiniBand NVIDIA Quantum HDR |

|---|---|---|

| Adaptador de Porta Dupla ConnectX-6 200 Gb/s (MCX653106A-HDAT) | Rede de 200 Gb/s, roteamento adaptativo | Switches 200 GbE (IEEE 802.3) |

| ✓ Compatível | Requer modos FEC por especificação do switch | GPU Direct RDMA |

| ✓ Sim | Série NVIDIA GPU (Volta, Ampere, Hopper, etc.) | VMware vSphere 7.0/8.0 |

| ✓ Certificado | Drivers nativos, suporte SR-IOV | Linux (RHEL, Ubuntu, SLES) |

| ✓ Suporte completo | MLNX_OFED, drivers inbox disponíveis | Windows Server 2019/2022 |

| ✓ Suportado | Pacote de driver WinOF-2 | Lista de Verificação do Comprador – Antes de Pedir o MCX653105A-HDAT |

- [ ] Verifique o slot PCIe do servidor: slot físico x16, Gen 4 recomendado para desempenho total de 200 Gb/s.

- [ ] Selecione cabos ou transceptores QSFP56 apropriados (cobre passivo até 5m, AOC ou ópticos).

- [ ] Verifique o suporte do driver do SO (versão OFED ou inbox).

- [ ] Garanta que os requisitos de conformidade de criptografia sejam atendidos (XTS-AES, FIPS).

- [ ] Avalie o resfriamento ambiental: adaptadores de alta velocidade podem exigir fluxo de ar direcionado.

- Produtos Relacionados