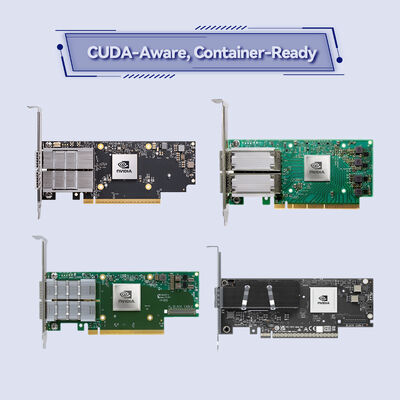

Adaptador InfiniBand NVIDIA MCX555A-ECAT de Porta Única 100Gb/s QSFP28 PCIe 3.0 x16 ConnectX-5

Detalhes do produto:

| Marca: | Mellanox |

| Número do modelo: | MCX555A-ECAT |

| Documento: | CONNECTX-5 infiniband.pdf |

Condições de Pagamento e Envio:

| Quantidade de ordem mínima: | 1 unidade |

|---|---|

| Preço: | Negotiate |

| Detalhes da embalagem: | Caixa externa |

| Tempo de entrega: | Baseado no inventário |

| Termos de pagamento: | T/T |

| Habilidade da fonte: | Fornecimento por projeto/lote |

|

Informação detalhada |

|||

| Status dos produtos: | Estoque | Aplicativo: | Servidor |

|---|---|---|---|

| Doença: | Novo e Original | Tipo: | Com fio |

| Velocidade máxima: | EDR e 100GBE | Conector Ethernet: | QSFP28 |

| Destacar: | Adaptador InfiniBand NVIDIA ConnectX-5,Placa de rede QSFP28 de 100Gb/s,Placa Mellanox PCIe 3.0 x16 |

||

Descrição de produto

Adaptador de rede de alto desempenho e baixa latência de 100Gb / s projetado para HPC, AI e centros de dados em nuvem.e correspondência de etiquetas para cargas de trabalho MPI, proporcionando um desempenho e eficiência de CPU líderes no setor.

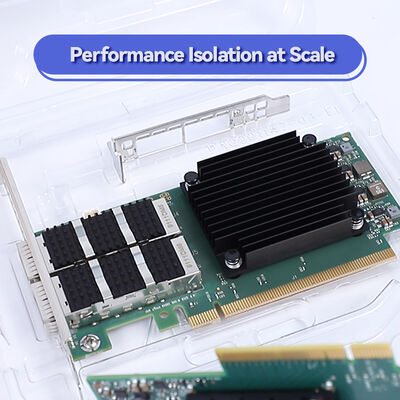

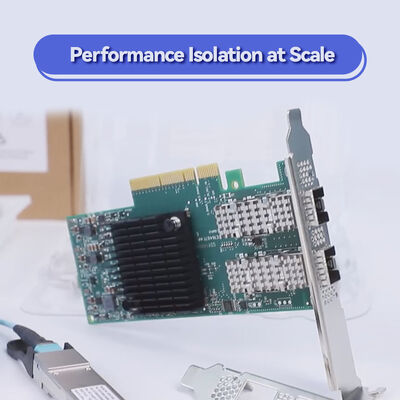

ONVIDIA ConnectX-5 MCX555A-ECATÉ uma placa de adaptador InfiniBand de 100Gb/s com uma única porta num fator de formato PCIe de baixo perfil.100 Gb/s de capacidadeO cartão suporta InfiniBand (até EDR) e 100GbE, fornecendo conectividade versátil para computação de alto desempenho, armazenamento,e ambientes virtualizados.

Construído com um switch PCIe incorporado e capacidades avançadas de RDMA, o MCX555A-ECAT descarrega tarefas críticas de comunicação da CPU, permitindo um maior desempenho da aplicação,menor consumo de energiaÉ totalmente compatível com slots PCIe 3.0 x16 e suporta uma ampla gama de sistemas operacionais e frameworks de aceleração.

- Até 100 Gb/sConectividade por porta (InfiniBand EDR / 100GbE)

- Conector QSFP28 únicopara cabos ópticos ou de cobre

- Interface de host PCIe 3.0 x16(auto-negocia para x8, x4, x2, x1)

- RDMA, semântica de envio/recepçãocom transporte fiável baseado em hardware

- Identificação e encontro de descargaspara MPI e SHMEM

- NVMe sobre tecidos (NVMe-oF)para armazenamento eficiente

- GPUDirect RDMA (PeerDirect)aceleração para comunicação com GPU

- Controle de congestionamento baseado em hardware e suporte de roteamento adaptativo

- Virtualização SR-IOV:até 512 funções virtuais

- Compatível com a RoHS, com baixo fator de forma(incluindo o bracket de altura)

A arquitetura ConnectX-5 integra uma gama de motores de aceleração de hardware que reduzem a intervenção da CPU e melhoram a escalabilidade dos aplicativos:

- MPI Tag Matching & Rendezvous Offload:Descarrega o processamento de correspondência de mensagens e protocolo de encontro, melhorando drasticamente o desempenho do MPI para clusters HPC.

- RDMA fora de ordem com roteamento adaptativo:Permite o uso eficiente de vários caminhos de rede, mantendo a semântica de conclusão ordenada, maximizando a utilização do tecido.

- NVMe-oF Destino de descarga:Permite que os sistemas de armazenamento NVMe servem acesso remoto com sobrecarga de CPU quase zero, ideal para arquiteturas de armazenamento desagregadas.

- Transportes dinâmicamente interligados (DCT):Fornece escalabilidade extrema para grandes sistemas de computação e armazenamento, eliminando a sobrecarga de configuração de conexão.

- ASAP2 Comutação acelerada e processamento de pacotes:Descarga de hardware para Open vSwitch (OVS) e túnel de rede de sobreposição (VXLAN, NVGRE, GENEVA).

- Paging sob demanda (ODP):Suporta paging de memória virtual para operações RDMA, simplificando o desenvolvimento de aplicativos.

- Computação de Alto Desempenho (HPC):Ideal para clusters de supercomputação, simulações baseadas em MPI e cargas de trabalho de pesquisa científica que exigem baixa latência e altas taxas de mensagens.

- Formação em IA e Aprendizado Profundo:Combinado com o GPUDirect RDMA, permite uma comunicação rápida de GPU para GPU entre nós, acelerando os tempos de treinamento.

- Sistemas de armazenamento NVMe-oF:Implementar como alvos de armazenamento ou iniciadores em ambientes NVMe over Fabrics para acesso de armazenamento de blocos de alto rendimento e baixa latência.

- Cloud e Data Centers Virtualizados:O SR-IOV e as descargas de virtualização suportam ambientes multi-locatários com QoS garantida e isolamento seguro.

- Negociação de Alta Frequência (HFT):A latência ultra-baixa e o carimbo de tempo de hardware (IEEE 1588v2) satisfazem as exigências das aplicações de serviços financeiros.

O MCX555A-ECAT foi projetado para uma ampla compatibilidade com switches NVIDIA InfiniBand (por exemplo, Quantum, Spectrum) e switches 100GbE de terceiros.Suporta DACs de cobre passivos e cabos ópticos ativos através de portas QSFP28.

Sistemas operacionais e software:

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, MPI de plataforma

- Kit de desenvolvimento de planos de dados (DPDK) para bypass do kernel

| Parâmetro | Especificações |

|---|---|

| Modelo | MCX555A-ECAT |

| Fator de forma | PCIe de baixo perfil (14,2 cm x 6,9 cm sem suporte), suporte alto pré-instalado, suporte curto incluído |

| Velocidade e tipo de porta | 1x QSFP28, até 100Gb/s InfiniBand (EDR) e 100GbE |

| Interface do host | PCI Express 3.0 x16 (compatível com x8, x4, x2, x1) |

| Suporte para InfiniBand | Compatível com o IBTA 1.3, 100Gb/s EDR, FDR, QDR, DDR, SDR; 8 faixas virtuais + VL15; 16 milhões de canais de E/S |

| Suporte Ethernet | 100GbE, 50GbE, 40GbE, 25GbE, 10GbE, 1GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| Capacidades de RDMA | RDMA sobre Ethernet convergente (RoCE), hardware de transporte confiável, RDMA fora de ordem, operações atômicas |

| Descargas de armazenamento | NVMe sobre Fabrics descarga de alvo, iSER, SRP, NFS RDMA, SMB Direct, transferência de assinatura T10 DIF |

| Virtualização | SR-IOV (até 512 funções virtuais), VMware NetQueue, NPAR, PCIe Access Control Services (ACS) |

| Descargas da CPU | TCP/UDP/IP descarga sem estado, LSO/LRO, descarga de soma de verificação, RSS/TSS, inserção/descarga de etiquetas VLAN/MPLS |

| Redes de sobreposição | Descarga de hardware para encapsulamento/desencapsulamento VXLAN, NVGRE, GENEVE |

| Gestão | NC-SI via MCTP, PLDM para monitor/controle e atualização de firmware, I2C, SPI, JTAG |

| Iniciação remota | Iniciação remota através de InfiniBand, Ethernet, iSCSI; suporte UEFI, PXE |

| Consumo de energia | Não especificado publicamente; faixa típica inferior a 20 W |

| Temperatura de funcionamento | 0°C a 55°C (ambiente típico) |

| Conformidade | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Nota: Especificações derivadas da documentação do produto NVIDIA ConnectX-5. Para obter os mais recentes detalhes e suporte ao firmware, consulte as notas oficiais de lançamento da NVIDIA.

| Número da peça de encomenda | Portos / Velocidade | Interface do host | Fator de forma | Características fundamentais |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe de baixo perfil | Portão único padrão, EDR InfiniBand / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe de baixo perfil | Dual-port, EDR/100GbE |

| MCX556A-EDAT | 2x QSFP28, 100 Gb/s | PCIe 4.0 x16 | PCIe de baixo perfil | ConectX-5 Ex, PCIe Gen4 melhorado |

| MCX556M-ECAT-S25 | 2x QSFP28, 100 Gb/s | 2x PCIe 3.0 x8 | Socket Direct | Conexão de servidor de duplo soquete através de um arnês |

| MCX545B-ECAN | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | OCP 2.0 Tipo 1 | Fator de forma do Open Compute Project |

Para variantes OCP ou Multi-Host, entre em contato com as vendas.

- Desempenho superior de aplicação:Descarga de hardware para MPI, NVMe-oF e sobrepõe núcleos de CPU livres para lógica de negócios.

- Tecido RDMA escalável:DCT, XRC e RDMA fora de ordem fornecem escalabilidade linear para milhares de nós.

- Aceleração da GPU pronta:GPUDirect RDMA permite acesso direto à memória entre GPUs e adaptadores de rede, eliminando gargalos da CPU em clusters de IA.

- Deslocamento flexível:Uma única porta QSFP28 simplifica o cablagem e é ideal para arquiteturas leaf-spine de 100Gb/s.

- Protecção dos investimentos:O suporte tanto para InfiniBand quanto para Ethernet permite uma transição perfeita entre os protocolos conforme as necessidades evoluem.

O Hong Kong Starsurge Group fornece suporte completo ao ciclo de vida dos adaptadores NVIDIA ConnectX-5, incluindo assistência de configuração pré-venda, orientação de atualização de firmware e serviço de garantia.A nossa equipa técnica pode ajudar:

- Verificação da compatibilidade com o servidor e com a infraestrutura do switch

- Ajuste de desempenho para cargas de trabalho de HPC ou armazenamento

- Opções de suportes personalizados e requisitos de embalagem a granel

- Serviços de processamento RMA e de substituição avançada

Entre em contacto com os nossos engenheiros de vendas para obter informações sobre os preços dos volumes e os prazos de entrega.

Descarga eletrostática (ESD):Manter na embalagem antiestática até à instalação.Requisitos de refrigeração:Assegurar um fluxo de ar adequado no chassi do servidor para manter a temperatura de funcionamento dentro da gama especificada.Atualizações do firmware:Use as ferramentas oficiais de firmware da NVIDIA (MFT) e verifique a compatibilidade com sua versão do sistema operacional e do driver antes de atualizar.Cable Bending (Flexão de cabo):Seguir as diretrizes do raio de curvatura do cabo QSFP28 para evitar a degradação do sinal.

Este é um produto de classe A. Em um ambiente residencial pode causar interferências de rádio.

Fundada em 2008,Hong Kong Starsurge Group Co., Limitedé um fornecedor de hardware de rede, serviços de TI e soluções de integração de sistemas orientado por tecnologia.Controladores, e cablagem de alta velocidade, a Starsurge combina uma profunda experiência técnica com uma abordagem orientada para o cliente.,e empresa, oferecendo soluções IoT, sistemas de gestão de rede, desenvolvimento de software personalizado e entrega global multilingue.A Starsurge ajuda os clientes a construir eficientes, infra-estrutura de rede escalável e confiável.

| Componente / Sistema | Estatuto de compatibilidade | Notas |

|---|---|---|

| Comutadores de banda infinita quânticos NVIDIA | Certificado | Compatibilidade EDR, HDR quando se utiliza um firmware adequado |

| Comutadores Ethernet de Espectro NVIDIA | Certificado | Módulos 100GbE, 50GbE, 25GbE suportados |

| Comutadores 100GbE de terceiros | Compatível | Requer conformidade com as normas IEEE; testado com os principais fornecedores |

| Servidores de GPU (NVIDIA DGX, HGX) | Certificado com GPUDirect | Aceleração RDMA para comunicação multi-GPU |

| Arquivos de armazenamento com NVMe-oF | Apoio | Descarga de alvo permite um acesso eficiente ao tecido NVMe |

- Confirme que o servidor tem um slot PCIe 3.0 x16 (ou x8) disponível com uma distância suficiente.

- ¢ Determinar o número de portas: de porta única (MCX555A-ECAT) versus de porta dupla (MCX556A-ECAT).

- ¢ Escolha o tipo de cabo: DAC de cobre passivo para distâncias curtas (≤ 5 m) ou óptico para corridas mais longas.

- Verificar o suporte ao sistema operativo e aos drivers (OFED, Windows, VMware).

- Para os clusters de GPU, certifique-se da compatibilidade GPUDirect RDMA com o seu modelo de GPU e versão do driver.

- Verifique se é necessário um suporte alto ou curto para o chassi do servidor.

- NVIDIA MCX556A-ECAT Adaptador ConnectX-5 de duas portas de 100 Gb/s

- NVIDIA MCX556A-EDAT ConnectX-5 Ex com suporte PCIe 4.0

- NVIDIA Quantum-2 QM9700 40 portas 800Gb/s InfiniBand Switch

- Cabos DAC passivos Mellanox QSFP28 (1m, 2m, 3m)

- Comutadores Ethernet NVIDIA Spectrum-4 SN5600 100GbE/400GbE

- NVIDIA ConnectX-5 InfiniBand Adaptador de Cartão Manual do Usuário

- RDMA sobre Ethernet Convergente (RoCE) Guia de implantação

- GPUDirect RDMA Melhores práticas para clusters de IA

- NVMe sobre Fabrics com ConnectX-5 Guia de configuração

- Guia de instalação e ajuste da OFED