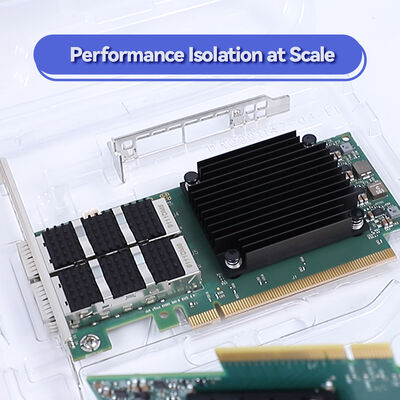

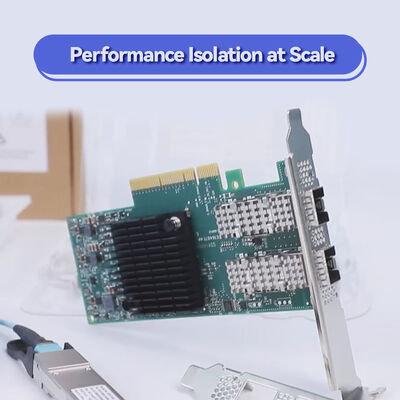

Adaptador InfiniBand NVIDIA ConnectX-7 NDR 400Gb/s MCX75310AAS-HEAT | PCIe Gen5 Dual-Port

Detalhes do produto:

| Marca: | Mellanox |

| Número do modelo: | MCX75310AAS-EAT (900-9X766-003N-ST0) |

| Documento: | Connectx-7 infiniband.pdf |

Condições de Pagamento e Envio:

| Quantidade de ordem mínima: | 1 unidade |

|---|---|

| Preço: | Negotiate |

| Detalhes da embalagem: | Caixa externa |

| Tempo de entrega: | Baseado no inventário |

| Termos de pagamento: | T/T |

| Habilidade da fonte: | Fornecimento por projeto/lote |

|

Informação detalhada |

|||

| Modelo NÃO.: | MCX75310AAS-EAT (900-9X766-003N-ST0) | Portas: | Porta única |

|---|---|---|---|

| Tecnologia: | Infiniband | Tipo de interface: | OSFP56 |

| Especificação: | 16,7cm x 6,9cm | Origem: | Índia / Israel / China |

| taxa de transmissão: | 200GBE | Interface do host: | Gen3 x16 |

Descrição de produto

Redes RDMA de latência ultrabaixa para fábricas de IA, clusters de HPC e nuvem hiperscala. Suporta InfiniBand NDR (400Gb/s) e Ethernet de até 400GbE. Motores de Computação na Rede, aceleração de segurança por hardware e pronto para GPUDirect® Storage.

A família NVIDIA ConnectX-7 redefine a interconexão de data centers com largura de banda de até 400Gb/s, transporte confiável baseado em hardware e computação avançada na rede. O modelo MCX75310AAS-HEAT pertence à série de adaptadores ConnectX-7 VPI, suportando tanto InfiniBand (NDR/HDR/EDR) quanto Ethernet (400GbE a 10GbE). Construído para IA, computação científica e armazenamento moderno definido por software, ele oferece latência sub-microssegundo e libera núcleos de CPU por meio de motores de aceleração para segurança, virtualização e NVMe-oF. Com interface host PCIe Gen5, este adaptador maximiza o movimento de dados para clusters de GPU e ambientes de negociação de alta frequência.

Utilizando ASAP² (Accelerated Switch and Packet Processing) e Zero-Touch RoCE, o adaptador simplifica a implantação, ao mesmo tempo que fornece criptografia de hardware em linha – da borda ao núcleo. As empresas podem preparar sua infraestrutura para o futuro com velocidades NDR e suporte flexível a múltiplos hosts.

InfiniBand NDR dual-port de 400Gb/s ou 400GbE, PCIe Gen5 x16 (até 32 lanes).

Offloads de operações coletivas SHARPv3, offload de protocolo de junção, memória a bordo para rajadas.

IPsec/TLS/MACsec AES-GCM 128/256 bits em linha, inicialização segura com raiz de confiança por hardware, criptografia de flash.

IEEE 1588v2 PTP (precisão de 12ns), SyncE, classe C G.8273.2, temporização acionada por tempo.

GPUDirect RDMA, GPUDirect Storage, offload NVMe-oF, handover de assinatura T10-DIF.

VXLAN, GENEVE, NVGRE, parser flexível programável, rastreamento de conexão (firewall L4).

NVIDIA ASAP² (Accelerated Switch and Packet Processing) descarrega caminhos de dados inteiros, oferecendo desempenho SDN na taxa de linha com zero sobrecarga de CPU. O ConnectX-7 integra virtualização de memória avançada: Paginação Sob Demanda (ODP), Registro em Modo de Usuário (UMR) e serviços de tradução de endereço (ATS) para cargas de trabalho conteinerizadas eficientes. Com suporte para SR-IOV, aceleração VirtIO e tecnologia Multi-Host (até 4 hosts), o adaptador permite desempenho bare-metal em ambientes virtualizados. O motor RoCE de hardware garante implantação zero-touch para tecidos Ethernet convergidos, enquanto a memória na rede reduz a latência para bibliotecas de comunicação MPI e coletivas (NVIDIA HPC-X, UCX, NCCL).

Para lidar com a segurança da borda ao núcleo, os motores de criptografia em linha gerenciam IPsec, TLS 1.3 e MACsec sem consumir núcleos de execução, tornando-o ideal para nuvens multi-tenant e serviços financeiros.

- Clusters de IA e Modelos de Linguagem Grande: RDMA e GPUDirect acelerando o treinamento distribuído em centenas de GPUs.

- Computação de Alto Desempenho (HPC): Offloads MPI, SHARPv3 para redução na rede, roteamento adaptativo.

- Data centers de Nuvem e Borda: Aceleração de rede overlay, offload VXLAN, SR-IOV.

- Armazenamento Definido por Software (SDS): NVMe/TCP, NVMe-oF, iSER, NFS sobre RDMA.

- Análise em Tempo Real e Trading: Latência ultrabaixa + sincronização PTP classe C.

| Componente / Ecossistema | Opções Suportadas |

|---|---|

| Interface Host | PCIe Gen5 (até x32 lanes, x16 típico), bifurcação PCIe, Multi-Host (4 hosts) |

| Sistemas Operacionais | Linux (RHEL, Ubuntu, drivers in-box), Windows Server, VMware ESXi (SR-IOV), Kubernetes |

| Virtualização e Contêineres | SR-IOV, aceleração VirtIO, offload NVMe over TCP para contêineres |

| Middleware / Bibliotecas HPC | OpenMPI, MVAPICH, MPICH, UCX, NCCL, UCC, OpenSHMEM, PGAS |

| Protocolos de Armazenamento | NVMe-oF (RDMA/TCP), SRP, iSER, NFS sobre RDMA, SMB Direct, GPUDirect Storage |

| Parâmetro | Especificação |

|---|---|

| Modelo do Produto | MCX75310AAS-HEAT |

| Fatores de Forma | PCIe HHHL / FHHL, OCP 3.0 SFF/TSFF (consulte o guia de pedidos) |

| Velocidades InfiniBand | NDR 400Gb/s, HDR 200Gb/s, EDR 100Gb/s |

| Velocidades Ethernet | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE (NRZ/PAM4) |

| Portas de Rede | Configurações de 1/2/4 portas (dependente do SKU; 2 portas típico para este modelo) |

| Barramento Host | PCI Express Gen 5.0 (compatível com Gen4/Gen3), até x32 lanes, dicas de processamento TLP, ATS, PASID |

| Offloads de Segurança | IPsec em linha (AES-GCM 128/256), TLS 1.3, MACsec, inicialização segura, criptografia de flash, atestação de dispositivo |

| RDMA / Transporte | Transporte confiável por hardware, XRC, DCT, Paginação Sob Demanda, UMR, GPUDirect RDMA |

| Sincronização e Timing | IEEE 1588v2 PTP, G.8273.2 Classe C, precisão de 12 ns, SyncE, PPS in/out, agendamento acionado por tempo |

| Gerenciamento | NC-SI, MCTP sobre PCIe/SMBus, PLDM (DSP0248/0267/0218), SPDM, flash SPI, JTAG |

| Inicialização Remota | Inicialização remota InfiniBand, iSCSI, UEFI, PXE |

| Redes Abertas | ASAP² para SDN, offload VXLAN/GENEVE/NVGRE, espelhamento de fluxo, QoS hierárquico, rastreamento de conexão L4 |

| Energia e Meio Ambiente | Consulte o manual do usuário (típico ~15W-25W dependendo da configuração), temperatura de operação: 0°C a 55°C (não especificado publicamente, confirme por SKU) |

| Exemplo de Número de Peça | Portas / Velocidade | Fator de Forma | Uso Típico |

|---|---|---|---|

| MCX75310AAS-HEAT | NDR 400Gb/s dual-port, PCIe 5.0 x16 | PCIe HHHL / FHHL | IA e HPC Top-of-rack, clusters de GPU |

| MCX75340AAS-HEAT (exemplo) | 4 portas NDR200 / 200GbE | OCP 3.0 | Hiperscala e multi-host |

| Outros SKUs ConnectX-7 | Porta única/dupla, 100G/200G/400G | OCP, FHHL | Empresas, appliances de armazenamento |

Para obter assistência na escolha do SKU correto (suporte a cabos, tipo de bracket, bracket alto/baixo) entre em contato com a equipe Starsurge.

- ✅ Peças genuínas e certificadas – garantia total, cadeia de suprimentos segura.

- ✅ Consultoria de arquitetura pré-vendas – design de cluster HPC / IA, ajuste de RDMA.

- ✅ Logística global e fulfillment rápido – estoque na Ásia/Europa/Américas.

- ✅ Firmware personalizado e opções OEM – solicite configuração em massa.

- ✅ Suporte técnico pós-vendas – integração de drivers, atualizações de firmware, RMA.

A Hong Kong Starsurge Group oferece suporte completo ao ciclo de vida: desde a validação de compatibilidade até a implantação e manutenção contínua. Nossos engenheiros auxiliam com:

- Design de fabricação InfiniBand e otimização de desempenho.

- Configuração RoCE para ambientes Ethernet.

- Integração com GPUDirect Storage e alvos NVMe-oF.

- Garantia padrão de 3 anos, com cobertura estendida disponível.

Preços por volume, envio em massa e personalização (brackets, puxadores) estão disponíveis mediante solicitação.

NDR inclui recursos avançados de computação na rede como SHARP, roteamento adaptativo e transporte confiável por hardware nativamente; o modo Ethernet usa RoCE para RDMA com a mesma taxa de linha. O ConnectX-7 suporta ambos via dupla personalidade.

Sim, o adaptador é retrocompatível com PCIe Gen4 e Gen3, mas com velocidade de lane reduzida. O melhor desempenho é alcançado em slots PCIe Gen5.

Sim, o ConnectX-7 suporta a tecnologia NVIDIA Multi-Host, permitindo que até 4 hosts independentes compartilhem o mesmo adaptador (dependente do SKU e cabeamento específicos). Por favor, confirme com o guia de pedidos.

IPsec (AES-GCM 128/256 bits), TLS (AES-GCM 128/256 bits) e MACsec (AES-GCM 128/256 bits). Todos descarregados da CPU.

Absolutamente. O ConnectX-7 descarrega NVMe over TCP, bem como NVMe-oF, reduzindo a sobrecarga da CPU do host para armazenamento.

- Garanta o fluxo de ar adequado no chassi do servidor ao usar transceptores de alta potência (ópticos ativos ou DAC).

- Use firmware fornecido pela NVIDIA ou validado pela Starsurge para correções de segurança.

- Instale o driver mais recente (MLNX_OFED ou in-box nativo) para habilitar os offloads completos de hardware.

- Verifique a compatibilidade QSFP-DD ou OSFP para ópticas 400G; consulte o guia de transceptores Ethernet da NVIDIA.

- Manuseio antiestático é necessário – o adaptador possui componentes PCIe sensíveis.

A Hong Kong Starsurge Group Co., Limited é um provedor de hardware de rede, serviços de TI e soluções de integração de sistemas impulsionado pela tecnologia. Fundada em 2008, a empresa atende clientes em todo o mundo com produtos que incluem switches de rede, NICs, pontos de acesso sem fio, controladores, cabos e equipamentos relacionados. Apoiada por uma equipe experiente de vendas e técnica, a Starsurge atende setores como governo, saúde, manufatura, educação, finanças e empresas. A empresa também oferece soluções de IoT, sistemas de gerenciamento de rede, desenvolvimento de software personalizado, suporte multilíngue e entrega global. Com uma abordagem centrada no cliente, a Starsurge foca em qualidade confiável, serviço responsivo e soluções personalizadas que ajudam os clientes a construir infraestrutura de rede eficiente, escalável e confiável.

✓ Parceiro autorizado para as principais marcas, incluindo produtos de rede NVIDIA.

| Taxa de Transferência Máxima | 400 Gb/s (NDR / 400GbE) | PCIe Gen5 | Até 32 lanes |

|---|---|---|---|

| Suporte RDMA | InfiniBand & RoCE | Segurança | IPsec/TLS/MACsec em linha |

| GPUDirect | RDMA + Armazenamento | Precisão de Sincronização | PTP de 12ns |

| Componente | Recomendado / Suportado | Observações |

|---|---|---|

| Servidores GPU (HGX/DGX) | Totalmente compatível com GPUDirect | Offload SHARP em InfiniBand |

| Switches Top-of-Rack | NVIDIA QM9700 (NDR), SN4000 (Ethernet) | Suportado |

| Hosts de Virtualização | VMware ESXi 7.0/8.0, KVM, Hyper-V | SR-IOV habilitado |

| Sistemas de Armazenamento | PureStorage, VAST Data, WEKA, Dell PowerScale | Pronto para NVMe-oF / RoCE |

| Cabos / Ópticas | NVIDIA DAC de cobre passivo, óptico ativo (400G SR4/DR4) | Confirmar matriz de compatibilidade |

- Confirme a configuração da porta (NDR dual-port ou 2x200G divididos) que corresponde ao seu plano de switch.

- Confirme o comprimento físico do slot PCIe e o tipo de bracket (HHHL / FHHL).

- Verifique a direção do fluxo de ar e os requisitos de cabos passivos/ativos.

- Garanta o suporte do driver do SO (versão MLNX_OFED para o seu kernel).

- Para recursos de segurança: habilite a inicialização segura e a criptografia em linha no firmware.

- Revise as opções de garantia e substituição antecipada.

64 portas 400G InfiniBand, integração SHARPv3.

200Gb/s econômico para clusters menores.

Aceleração de armazenamento e segurança + caminho de dados programável.

OSFP para 2xOSFP ou 2xQSFP56 compatíveis.