NVIDIA mellanox ConnectX-6 MCX653106A-HDAT Dual-Port 200Gb/s InfiniBand Smart Adaptador PCIe 4.0 x16, Computação em Rede

Detalhes do produto:

| Marca: | Mellanox |

| Número do modelo: | MCX653106A-HDAT-SP |

| Documento: | connectx-6-infiniband.pdf |

Condições de Pagamento e Envio:

| Quantidade de ordem mínima: | 1 unidade |

|---|---|

| Preço: | Negotiate |

| Detalhes da embalagem: | Caixa externa |

| Tempo de entrega: | Baseado no inventário |

| Termos de pagamento: | T/T |

| Habilidade da fonte: | Fornecimento por projeto/lote |

|

Informação detalhada |

|||

| Status dos produtos: | Estoque | Aplicativo: | Servidor |

|---|---|---|---|

| Doença: | Novo e Original | Tipo: | Com fio |

| Velocidade máxima: | Até 200 GB/s | Conector Ethernet: | QSFP56 |

| Modelo: | MCX653106A-HDAT | Nome: | Cofre forte esperto de alta velocidade da placa de rede 200gbe de MCX653106A-HDAT-SP Mellanox |

| Destacar: | Adaptador de rede Mellanox ConnectX-6,Adaptador inteligente InfiniBand de 200 Gb/s,Cartão de rede PCIe 4.0 X16 |

||

Descrição de produto

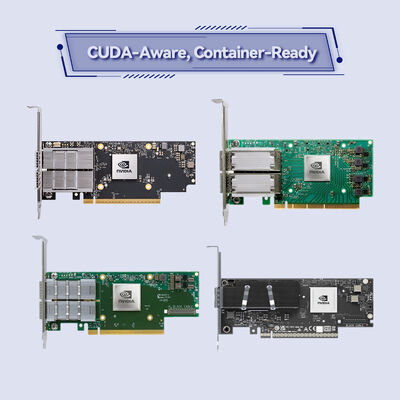

Adaptador Inteligente InfiniBand Dual-Port NVIDIA ConnectX-6 MCX653106A-HDAT de 200 Gb/s

Placa adaptadora inteligente InfiniBand e Ethernet líder de mercado de 200 Gb/s com portas QSFP56 duplas — oferecendo aceleração de computação em rede, criptografia em nível de bloco e interface de host PCIe 4.0 x16 para data centers HPC, IA e nuvem.

- Conectividade InfiniBand (HDR) ou 200/100/50/40/25/10GbE dual-port de 200 Gb/s

- PCIe Gen 4.0 x16 (também compatível com Gen 3.0) | Até 215 milhões de mensagens por segundo

- Offloads de hardware: destino/iniciador NVMe-oF, criptografia XTS-AES de 256/512 bits, correspondência de tags MPI

- Suporte NVIDIA In-Network Computing e GPUDirect RDMA

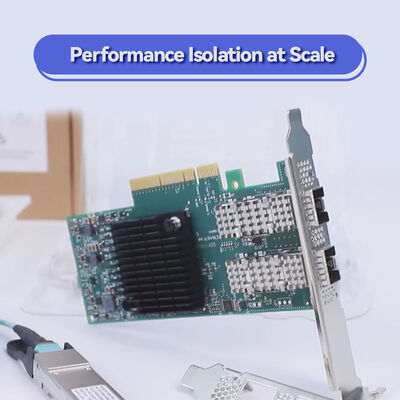

- Fator de forma PCIe stand-up de baixo perfil, compatível com RoHS

Características

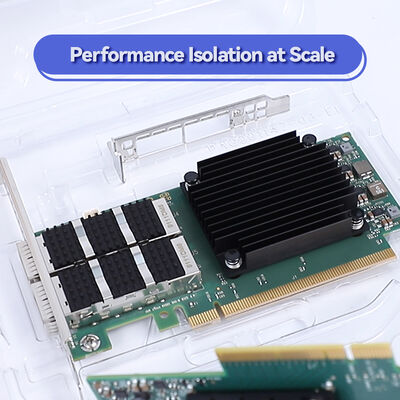

- Taxa de transferência de 200 Gb/s: Portas duplas operando em até 200 Gb/s InfiniBand (HDR) ou Ethernet com largura de banda bidirecional total.

- Computação em Rede: Offloads de operações coletivas (MPI, NCCL, SHMEM) usando a tecnologia NVIDIA SHARP.

- Criptografia em Nível de Bloco: Criptografia/descriptografia de hardware AES-XTS de 256/512 bits sem sobrecarga da CPU; compatível com FIPS.

- Offloads NVMe-oF: Offloads de destino e iniciador para NVMe over Fabrics, reduzindo a utilização da CPU.

- Virtualização Avançada: SR-IOV até 1K VFs, aceleração ASAP² para OVS e comutação virtual.

Tecnologia e Padrões

O MCX653106A-HDAT integra motores NVIDIA In-Network Computing (SHARP), RDMA (IBTA 1.3), RoCE, e NVMe-oF. Ele suporta PCIe Gen 4.0 (32 lanes como 2x16), PAM4 e NRZ SerDes, e recursos avançados como Dynamically Connected Transport (DCT), On-Demand Paging (ODP), e Adaptive Routing. Offloads de overlay para VXLAN, NVGRE, Geneve são acelerados por hardware. Compatível com as especificações IEEE 802.3bj, 802.3bm, 802.3by e InfiniBand Trade Association.

Princípio de Funcionamento: Arquitetura de Offload Inteligente

O ConnectX-6 descarrega tarefas de comunicação e armazenamento da CPU do host para o hardware do adaptador. Para coletivos MPI, o adaptador processa dados em trânsito usando SHARP, reduzindo o tráfego de endpoint. Para armazenamento, os comandos NVMe-oF são processados diretamente no adaptador, liberando núcleos da CPU. A criptografia/descriptografia de bloco ocorre em linha na velocidade da rede. O resultado é menor latência, maior taxa de mensagens (215 Mpps) e escalabilidade de aplicativos aprimorada.

Aplicações e Implantação

- Clusters HPC: Simulações baseadas em MPI que exigem baixa latência e alta taxa de mensagens.

- Treinamento de IA: Clusters de GPU NVIDIA com GPUDirect RDMA e coletivos NCCL.

- Armazenamento NVMe-oF: Offload de destino/iniciador para acesso a armazenamento NVMe de alto desempenho.

- Data Centers Virtualizados: SR-IOV e ASAP² para offload OVS em NFV e nuvem.

- Servidores Multi-Socket: Configurações Socket Direct para contornar gargalos QPI/UPI.

Especificações Técnicas e Opções de Pedido

| Modelo | Portas e Velocidade | Interface do Host | Fator de Forma | Criptografia | Protocolos | OPN |

|---|---|---|---|---|---|---|

| ConnectX-6 | 2x QSFP56 (200 Gb/s IB/Eth) | PCIe 4.0 x16 (Gen 3 compatível) | PCIe stand-up (baixo perfil) | AES-XTS 256/512 bits | InfiniBand, Ethernet, NVMe-oF | MCX653106A-HDAT |

| ConnectX-6 | 1x QSFP56 (200 Gb/s) | PCIe 4.0 x16 | PCIe stand-up | AES-XTS | IB/Eth | MCX653105A-HDAT |

| ConnectX-6 | 2x QSFP56 (200 Gb/s) | PCIe 4.0 x16 | OCP 3.0 | AES-XTS | IB/Eth | MCX653436A-HDAT |

Nota: O MCX653106A-HAT suporta InfiniBand de 200 Gb/s (HDR) e 200/100/50/25/10GbE. Dimensões: 167,65 mm x 68,90 mm (sem suporte). Inclui suporte alto (acessório de suporte curto). Consumo de energia < 15W típico.

Vantagens e Diferenciais

- vs. Geração Anterior (ConnectX-5): Largura de banda dobrada (200 Gb/s vs. 100 Gb/s), SHARP integrado para computação em rede e criptografia em nível de bloco.

- vs. NICs Concorrentes: Offload real de hardware para NVMe-oF e coletivos MPI — não apenas offloads stateless.

- Opção Socket Direct: Disponível para servidores multi-socket para eliminar gargalos UPI/QPI.

- Conformidade FIPS: Criptografia de hardware atende aos padrões de segurança governamentais.

Serviço e Suporte

Oferecemos consulta técnica 24/7, serviços de RMA e suporte de integração para adaptadores ConnectX-6. Cada placa é coberta por uma garantia de 1 ano (extensível). Nossa equipe fornece validação de drivers para as principais distribuições Linux, Windows e VMware. Assistência de configuração pré-venda para projeto de fabricação InfiniBand está disponível.

Perguntas Frequentes (FAQ)

P: O MCX653106A-HDAT é compatível com switches Quantum de 200 Gb/s?

R: Sim, é totalmente interoperável com switches NVIDIA Quantum QM8700/QM8790 e switches Quantum-2 ao usar o modo HDR ou NDR com cabos apropriados.

P: Este adaptador pode ser usado tanto para Ethernet quanto para InfiniBand?

R: Sim, ele suporta ambos os protocolos InfiniBand e Ethernet. O firmware detecta automaticamente o tipo de switch e configura o modo apropriado.

P: Ele suporta RoCE (RDMA over Converged Ethernet)?

R: Sim, o ConnectX-6 suporta totalmente RoCE, fornecendo RDMA de baixa latência em ambientes Ethernet.

P: Qual é a taxa máxima de mensagens?

R: O adaptador oferece até 215 milhões de mensagens por segundo, ideal para cargas de trabalho HPC de pacotes pequenos.

P: A placa é compatível com slots PCIe Gen 3.0?

R: Sim, é retrocompatível com PCIe Gen 3.0 (x16), embora a largura de banda seja limitada a ~100 Gb/s por porta devido aos limites do Gen 3.

Precauções e Notas de Compatibilidade

- Requisito de Slot PCIe: Para desempenho total de 200 Gb/s, instale em um slot PCIe Gen 4.0 x16. Slots Gen 3.0 limitarão a taxa de transferência.

- Resfriamento: Garanta fluxo de ar adequado no chassi do servidor; resfriamento passivo requer um mínimo de 200 LFM.

- Cabeamento: Use módulos QSFP56 de cobre passivo/ativo ou ópticos classificados para 200 Gb/s (HDR).

- Suporte a Drivers: Use o mais recente NVIDIA MLNX_OFED para Linux ou WinOF-2 para Windows.

- Temperatura de Operação: 0°C a 70°C; armazene entre -40°C e 85°C.

Introdução à Empresa

Com mais de uma década de experiência, operamos uma fábrica em larga escala apoiada por uma forte equipe técnica. Nossa extensa base de clientes e expertise no domínio nos permitem oferecer preços competitivos sem comprometer a qualidade. Como distribuidores autorizados de Mellanox, Ruckus, Aruba e Extreme, estocamos switches de rede originais, soluções de placas de rede (placas NIC), pontos de acesso sem fio, controladores e cabos. Mantemos um estoque de 10 milhões de dólares para garantir o cumprimento rápido em diversas linhas de produtos. Cada remessa é verificada quanto à precisão e fornecemos consulta e suporte técnico 24/7. Nossas equipes profissionais de vendas e técnicas conquistaram uma alta reputação nos mercados globais — faça parceria conosco para obter soluções de infraestrutura confiáveis.